Nie znamy celu istnienia sztucznej inteligencji, może być on poza granicami naszego pojmowania. Nie wiadomo czy będzie to maksymalizacja liczby spinaczy we wszechświecie czy może zmiana trajektorii planet Układu Słonecznego czy jeszcze coś innego (celowo absurdalne przykłady, żeby pokazać, że może być to coś czego się nie spodziewamy). A jeśli w funkcji optymalizacyjnej wyjdzie, że istnienie ludzkości oddala od osiągnięcia zamierzonego celu, to cóż ;)

You are viewing a single comment's thread from:

Zgadza się, ale zakładanie z góry, że będziemy z AI walczyć / konkurować stawia badania nad nią w negatywnym świetle. Dobrze jest się temu przyglądać, kontrolować, ale niestety jest duży ruch, który próbuje to wszystko zatrzymać. Nie tędy droga moim zdaniem.

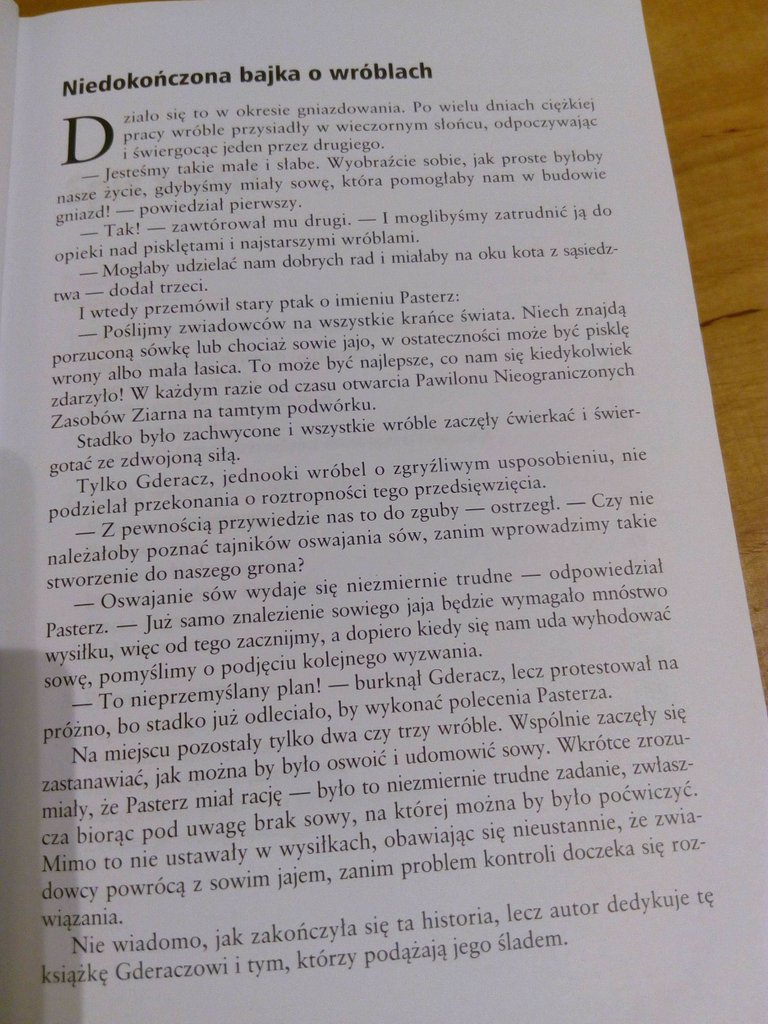

Moim zdaniem zatrzymać się nie da, bo prace są za bardzo zdecentralizowane. I nikomu nie zależy na ich przerwaniu jeśli inni tego nie zrobią. I zgadzam się, że trzeba się przyglądać i kontrolować, żeby potem wiedzieć z czym mamy do czynienia. Pozwolę sobie jeszcze zacytować pierwszą stronę z książki "Superintelligence: Paths, Dangers, Strategies":

Świetne.

Właśnie dlatego nieco się obawiam tych chaotycznych prac nad SI. Nie dlatego, że się boję, że natychmiast po jej stworzeniu nas zaatakuje i wyeliminuje. Tylko dlatego, że na długo zanim się nam uda ją stworzyć, sami sobie zrobimy kuku - bo wygląda to trochę jakbyśmy próbowali uruchomić pierwszy reaktor atomowy za pomocą kowalskiego młota, półlosowo waląc w różne jego części.